最早是阿里的通义千问全民舞王跳科目三是很火的,热门作品都是到百万的,到最近炙手可热的可灵AI,但是可灵的全民舞王竟然是限量生成次数且超过收费的,一如既往的,腾讯,又是腾讯,它又又又又开源了,最早的阿里,咩咩咩,我好久没去看Emo的issue了 ,但实际上阿里是有开源很多优秀的产品的,比如媲美chatTTS的语音克隆项目,数字人项目等等,但是Emo的衬托大家关注的变少了,但是腾讯一如既往的闷声开源,支持windows一键整合包,comfyui工作流,webui嘛~~还得等~

,但实际上阿里是有开源很多优秀的产品的,比如媲美chatTTS的语音克隆项目,数字人项目等等,但是Emo的衬托大家关注的变少了,但是腾讯一如既往的闷声开源,支持windows一键整合包,comfyui工作流,webui嘛~~还得等~

生成效果展示

温馨提示公众号已开启留言功能哦,点击上方蓝色字,回复关键字【mim】领取Comfyui工作流和windows一键整合包~~码字不易,希望大家点赞收藏在看~~

往期精彩内容

超越MJ6 快手kolors 手慢无 ComfyUI工作流合集分享第三期

全网首发:Stable Diffusion 3 Medium SD3模型参见 附带Comfyui工作流

1. MimicMotion简介

MimicMotion 是由腾讯公司推出的一款人工智能人像动态视频生成框架。该框架利用先进的技术,能够根据用户提供的单个参考图像和一系列要模仿的姿势,生成高质量、姿势引导的人类动作视频。MimicMotion 的核心在于其置信度感知的姿态引导技术,确保视频帧的高质量和时间上的平滑过渡。

2. 功能特色

MimicMotion 的功能特色包括:

-

生成多样化视频:能够根据用户提供的姿态指导生成各种动作的视频内容,如舞蹈、运动或日常活动。

-

控制视频长度:用户可以指定视频的持续时间,从几秒的短片段到几分钟甚至更长的完整视频。

-

姿态引导控制:使用参考姿态作为条件,确保视频内容在动作上与指定姿态保持一致,实现高度定制化的视频生成。

-

细节质量保证:特别关注视频中的细节,尤其是手部等容易失真的区域,通过置信度感知的策略提供更清晰的视觉效果。

-

时间平滑性:确保视频帧之间的过渡平滑,避免卡顿或不连贯的现象,使视频看起来更加流畅自然。

-

减少图像失真:通过置信度感知的姿态引导,减少由于姿态估计不准确导致的图像失真。

-

长视频生成:采用渐进式潜在融合技术,生成长视频时保持高时间连贯性。

-

资源消耗控制:优化算法以确保资源消耗保持在合理范围内,即使在生成较长视频时也能有效地管理计算资源。

3. 官网入口

MimicMotion 的官网提供了项目的详细信息,包括技术原理、使用教程和下载链接。用户可以通过官网进一步了解框架的功能和如何使用它。具体的官网入口可以通过搜索 "MimicMotion 官网" 找到,或者访问腾讯相关的技术平台页面。

添加描述

4. 技术原理

MimicMotion 的技术原理涉及多个方面:

-

姿态引导的视频生成:利用用户提供的姿态序列作为输入条件,引导视频内容的生成。

-

置信度感知的姿态指导:通过分析姿态估计模型提供的置信度分数,对姿态序列中的每个关键点进行加权,以减少不准确姿态估计对生成结果的影响。

-

区域损失放大:针对手部等容易失真的区域,在损失函数中增加权重,提高生成视频的手部细节质量。

-

潜在扩散模型:使用潜在扩散模型提高生成效率和质量,减少计算成本。

-

渐进式潜在融合:生成长视频时,通过逐步融合重叠帧的潜在特征,实现视频段之间的平滑过渡。

-

预训练模型的利用:基于预训练的视频生成模型(如Stable Video Diffusion, SVD),减少训练所需的数据量和计算资源。

-

U-Net和PoseNet的结构:模型结构包括用于空间时间交互的U-Net和提取姿态序列特征的PoseNet,共同实现高质量的视频生成。

添加描述

5. 如何体验MimicMotion?

要体验 MimicMotion,用户需要准备输入参考图像和姿势序列。然后,可以使用 MimicMotion 模型进行视频生成,并根据需要调整置信度感知姿态引导的参数。此外,应用区域损失放大策略可以优化特定区域的图像质量。利用渐进式潜在融合策略,用户可以生成长视频,并通过重叠扩散技术生成任意长度的视频。进行用户研究和消融研究可以帮助评估和改进视频生成效果。

添加描述

通过上述步骤,用户可以充分利用 MimicMotion 的强大功能,生成符合特定需求的动态视频内容。

windows安装视频演示

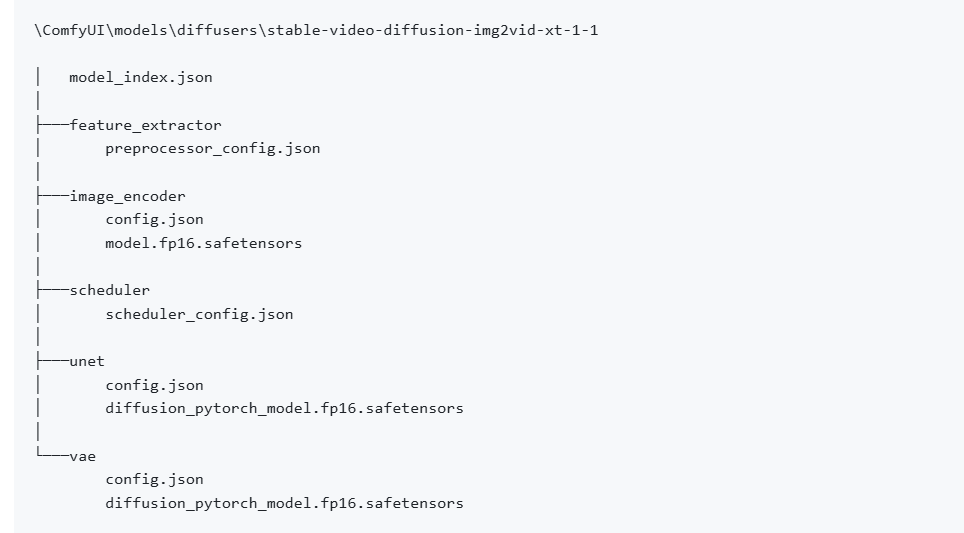

Comfyui层级结构

51工具盒子

51工具盒子