本专题致力于深入探讨如何通过SpringBoot3.x框架与OpenCV库实现高效的人脸检测和人脸识别系统。通过系统化的10篇文章,从基础概念到高级应用,结合代码示例和实战案例,逐步引导大家掌握从零开始构建完整人脸检测与识别系统的全过程。

本专题致力于深入探讨如何通过SpringBoot3.x框架与OpenCV库实现高效的人脸检测和人脸识别系统。通过系统化的10篇文章,从基础概念到高级应用,结合代码示例和实战案例,逐步引导大家掌握从零开始构建完整人脸检测与识别系统的全过程。

基于 Spring Boot 的实时人脸检测和识别系统

随着人工智能和计算机视觉技术的不断发展,实时人脸检测和识别技术在安防、考勤、门禁控制等领域的应用越来越广泛。实现一个高效、稳定的实时人脸检测和识别系统,需要解决包括延迟、数据一致性、并发处理等相关技术难题。本文将深入讲解如何基于Spring Boot和WebSocket实现一个实时人脸检测和识别系统,并结合具体代码示例进行讲解。

基本需求和挑战

-

实时检测和识别需求

-

高实时性:视频流中的人脸图像需要被及时检测和识别,并同步到客户端。

-

高准确性:检测和识别算法需要具有高准确率,减少误识别和漏识别现象。

-

-

技术挑战

-

系统延迟:在高并发访问下,需要保证检测和识别的快速响应,降低系统延迟。

-

数据一致性:在多客户端并发访问和多个传感器同时上传数据时,确保数据一致性和同步。

-

扩展性:系统需要具备良好的扩展性,能够处理不断增加的数据量和访问量。

-

实现方案

1. 使用Spring Boot和WebSocket实现实时人脸检测

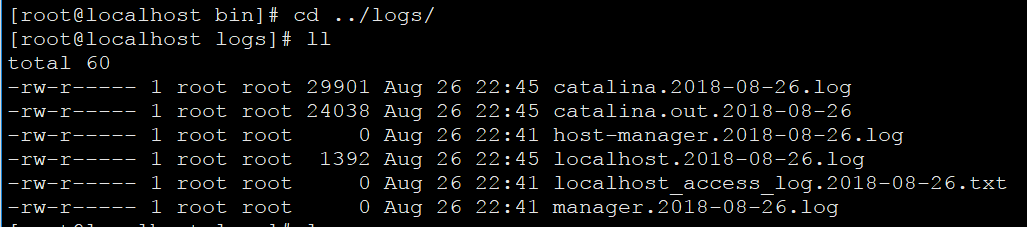

依赖配置

在项目的 pom.xml 文件中添加以下依赖,以支持Spring Boot和WebSocket:

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>javacpp</artifactId>

<version>1.5.5</version>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>javacv-platform</artifactId>

<version>1.5.5</version>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>dlib-platform</artifactId>

<version>19.21.1-1.5.5</version>

</dependency>

<dependency>

<groupId>net.sourceforge.tess4j</groupId>

<artifactId>tess4j</artifactId>

<version>4.5.3</version>

</dependency>

WebSocket配置

创建 WebSocketConfig 配置类,实现 WebSocket 的配置:

import org.springframework.context.annotation.Configuration;

import org.springframework.web.socket.config.annotation.EnableWebSocket;

import org.springframework.web.socket.config.annotation.WebSocketConfigurer;

import org.springframework.web.socket.config.annotation.WebSocketHandlerRegistry;

@Configuration

@EnableWebSocket

public class WebSocketConfig implements WebSocketConfigurer {

@Override

public void registerWebSocketHandlers(WebSocketHandlerRegistry registry) {

// 注册WebSocket处理器

registry.addHandler(new FaceDetectionHandler(), "/faceDetection")

.setAllowedOrigins("*"); // 允许所有域名的跨域请求

}

}

视频流处理

使用 OpenCV 库进行视频流处理和人脸检测:

import org.opencv.core.Mat;

import org.opencv.core.Rect;

import org.opencv.core.Size;

import org.opencv.imgproc.Imgproc;

import org.opencv.objdetect.CascadeClassifier;

import org.opencv.videoio.VideoCapture;

import org.springframework.web.socket.TextMessage;

import org.springframework.web.socket.WebSocketSession;

import org.springframework.web.socket.handler.TextWebSocketHandler;

import java.io.ByteArrayInputStream;

import javax.imageio.ImageIO;

import java.awt.image.BufferedImage;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

public class FaceDetectionHandler extends TextWebSocketHandler {

private static final List<WebSocketSession> sessions = new ArrayList<>();

static {

System.loadLibrary(Core.NATIVE_LIBRARY_NAME);

}

@Override

public void afterConnectionEstablished(WebSocketSession session) throws Exception {

sessions.add(session); // 连接建立后添加会话

}

@Override

public void afterConnectionClosed(WebSocketSession session, CloseStatus status) throws Exception {

sessions.remove(session); // 连接关闭时移除会话

}

@Override

protected void handleTextMessage(WebSocketSession session, TextMessage message) throws Exception {

// 处理收到的消息并广播给所有连接的会话

for (WebSocketSession webSocketSession : sessions) {

webSocketSession.sendMessage(message);

}

}

// 推送人脸检测结果

public void sendFaceDetectionResult(String imageBase64) {

for (WebSocketSession session : sessions) {

try {

session.sendMessage(new TextMessage(imageBase64)); // 发送消息

} catch (IOException e) {

e.printStackTrace();

}

}

}

// 处理视频流,检测人脸

public void processVideoStream() {

VideoCapture camera = new VideoCapture(0);

if (!camera.isOpened()) {

System.out.println("Camera Error");

return;

}

CascadeClassifier faceDetector = new CascadeClassifier("haarcascade_frontalface_alt.xml");

Mat frame = new Mat();

while (camera.read(frame)) {

Mat frameGray = new Mat();

Imgproc.cvtColor(frame, frameGray, Imgproc.COLOR_BGR2GRAY);

Imgproc.equalizeHist(frameGray, frameGray);

Rect[] facesArray = faceDetector.detectMultiScale(frameGray);

for (Rect face : facesArray) {

Imgproc.rectangle(frame, face.tl(), face.br(), new Scalar(0, 255, 0), 3);

}

BufferedImage image = matToBufferedImage(frame);

String imageBase64 = imageToBase64(image);

sendFaceDetectionResult(imageBase64);

}

camera.release();

}

private BufferedImage matToBufferedImage(Mat mat) {

// Convert Mat to BufferedImage

MatOfByte mob = new MatOfByte();

Imgcodecs.imencode(".jpg", mat, mob);

byte[] byteArray = mob.toArray();

BufferedImage bufImage = null;

try {

bufImage = ImageIO.read(new ByteArrayInputStream(byteArray));

} catch (IOException e) {

e.printStackTrace();

}

return bufImage;

}

private String imageToBase64(BufferedImage image) {

// Convert BufferedImage to Base64 String

ByteArrayOutputStream baos = new ByteArrayOutputStream();

try {

ImageIO.write(image, "jpg", baos);

byte[] bytes = baos.toByteArray();

return Base64.getEncoder().encodeToString(bytes);

} catch (IOException e) {

e.printStackTrace();

}

return null;

}

}

2. 结合视频流实现实时人脸识别

在检测到人脸后,通过人脸识别算法进行识别,并返回识别结果:

import org.springframework.web.bind.annotation.PostMapping;

import org.springframework.web.bind.annotation.RequestBody;

import org.springframework.web.bind.annotation.RequestMapping;

import org.springframework.web.bind.annotation.RestController;

import redis.clients.jedis.Jedis;

@RestController

@RequestMapping("/api/face")

public class FaceRecognitionController {

@Autowired

private FaceDetectionHandler faceDetectionHandler; // 注入WebSocket消息处理器

private Jedis jedis = new Jedis("localhost");

@PostMapping("/recognize")

public void recognizeFace(@RequestBody FaceRecognitionRequest request) {

// 假设FaceRecognitionService进行了人脸识别

String recognizedPerson = FaceRecognitionService.recognize(request.getImageBase64());

// 更新 Redis 中的识别结果

jedis.set("recognizedPerson", recognizedPerson);

// 通过 WebSocket 推送识别结果

faceDetectionHandler.sendFaceRecognitionResult(recognizedPerson);

}

}

FaceRecognitionService示例:

import org.bytedeco.dlib.*;

import org.bytedeco.dlib.global.dlib;

import org.bytecode.*;

import java.nio.file.;

import java.util.;

public class FaceRecognitionService {

private frontal_face_detector detector;

private shape_predictor sp;

private anet_type net;

private List<FaceProfile> knownFaces;

public FaceRecognitionService() {

detector = dlib.get_frontal_face_detector();

sp = new shape_predictor("shape_predictor_68_face_landmarks.dat");

net = new anet_type();

dlib.deserialize("dlib_face_recognition_resnet_model_v1.dat").to(net);

knownFaces = loadKnownFaces();

}

// 加载已知人脸数据

private List<FaceProfile> loadKnownFaces() {

List<FaceProfile> faces = new ArrayList<>();

// 读取已知人脸图像和特征

// 这里可以从数据库或文件系统加载已知人脸数据

return faces;

}

// 识别人脸

public String recognize(String imageBase64) {

// 解码Base64图片

byte[] decodedBytes = Base64.getDecoder().decode(imageBase64);

Mat img = ImgCodecs.imdecode(new Mat(decodedBytes), ImgCodecs.IMREAD_COLOR);

// 检测人脸

dlib.rectangles faces = detector.apply(img);

ArrayList<Matrix> faceDescriptors = new ArrayList<>();

for (rect face : faces) {

full_object_detection shape = sp.apply(img, face);

Matrix face_chip = new Matrix();

extract_image_chip.apply(img, get_face_chip_details.apply(shape, 150, 0.25) , face_chip);

faceDescriptors.add(net.apply(face_chip));

}

// 比对人脸

if (faceDescriptors.size() > 0) {

Matrix faceDescriptor = faceDescriptors.get(0);

String recognizedPerson = findBestMatch(faceDescriptor);

return recognizedPerson;

}

return "Unknown";

}

// 比对人脸特征,找到最佳匹配

private String findBestMatch(Matrix faceDescriptor) {

double minDistance = Double.MAX_VALUE;

String bestMatch = "Unknown";

for (FaceProfile knownFace : knownFaces) {

double distance = length(subtract(faceDescriptor, knownFace.getFaceDescriptor()));

if (distance < minDistance) {

minDistance = distance;

bestMatch = knownFace.getName();

}

}

return bestMatch;

}

}

class FaceProfile {

private String name;

private Matrix faceDescriptor;

public FaceProfile(String name, Matrix faceDescriptor) {

this.name = name;

this.faceDescriptor = faceDescriptor;

}

public String getName() {

return name;

}

public Matrix getFaceDescriptor() {

return faceDescriptor;

}

}

3. 讨论系统延迟和优化策略

-

系统延迟问题

-

视频帧处理延迟:由于视频帧处理需要完成面部检测和识别,可能会导致延迟。

-

网络传输延迟:视频流数据和识别结果需要通过网络进行传输,传输过程中的网络波动可能导致延迟。

-

-

优化策略

-

硬件加速:利用GPU进行视频帧和人脸检测、识别计算,提高计算速度,降低处理延迟。

-

改进算法效率:优化图像处理和人脸识别算法,减少单帧处理时间。

-

并行处理:引入多线程并行处理技术,如将检测与识别步骤分离,独立处理不同视频流帧。

-

视频编码优化:利用高效的视频编码技术,减少视频传输数据量,降低网络传输时间。

-

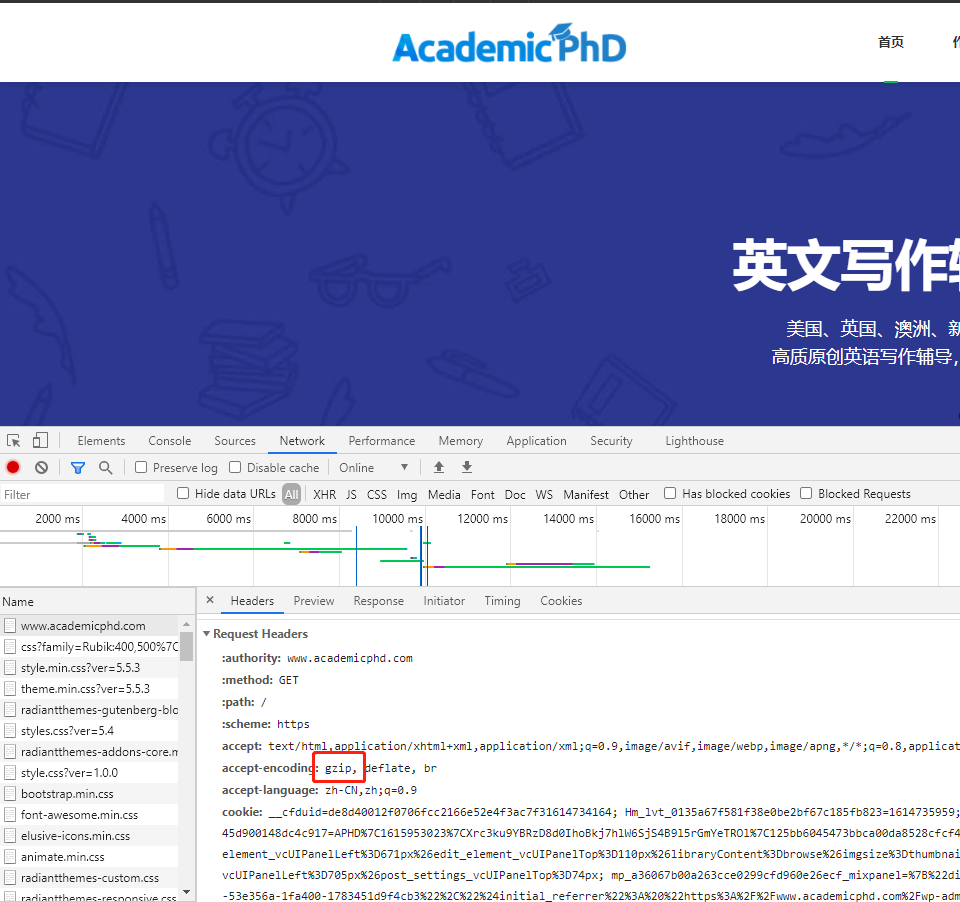

前端 WebSocket 客户端实现

在前端实现 WebSocket 客户端,以接收和展示实时检测与识别的结果。

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<title>实时人脸检测和识别</title>

</head>

<body>

<h1>实时人脸检测和识别结果</h1>

<div id="video-container">

<img id="video-frame" src="" alt="Video Frame">

<p id="recognition-result"></p>

</div>

<script>

// 初始化WebSocket连接

const socket = new WebSocket('ws://localhost:8080/faceDetection');

socket.onopen = function(event) {

console.log("WebSocket connection established!");

};

socket.onmessage = function(event) {

// 解析WebSocket消息

const message = JSON.parse(event.data);

if (message.type === 'detection') {

// 更新视频帧

document.getElementById('video-frame').src = 'data:image/jpeg;base64,' + message.data;

} else if (message.type === 'recognition') {

// 更新识别结果

document.getElementById('recognition-result').innerText = '识别结果: ' + message.data;

}

};

socket.onclose = function(event) {

console.log("WebSocket connection closed.");

};

</script>

</body>

</html>

这个前端页面展示了一个简单的实时视频流容器,以及一个显示人脸识别结果的文本框。WebSocket 客户端接收到服务器推送的检测结果和识别结果,并进行展示。

完整代码结构

以下是一个完整的项目结构,供大家参考:

com.example.facedetection

├───config

| └───WebSocketConfig.java

├───controller

| └───FaceRecognitionController.java

├───handler

| └───FaceDetectionHandler.java

├───service

| └───FaceRecognitionService.java

├───FaceDetectionApplication.java

├───resources

| └───application.properties

└───static

└───index.html

总结

本文首先介绍了实时人脸检测和识别系统的基本需求和技术挑战。接着,通过Spring Boot和WebSocket技术实现了一个简单的实时人脸检测与识别系统,并结合代码示例详细讲解了实现过程。

这个系统在实际应用中还需要进一步优化和扩展,包括提升检测和识别精度、降低系统延迟、实现分布式部署等。相信大家通过本文的学习,对实现一个实时人脸检测和识别系统有了更深入的理解和掌握。

51工具盒子

51工具盒子